| 面向自动驾驶的多模态信息融合动态目标识别 |

| |

| 作者姓名: | 张明容 喻皓 吕辉 姜立标 李利平 卢磊 |

| |

| 作者单位: | 1.广东轻工职业技术学院 汽车技术学院,广州 510000;2.广汽埃安新能源汽车股份有限公司研发中心,广州 511400;3.华南理工大学 机械与汽车工程学院,广州 510641;4.广州城市理工学院 工程研究院,广州 510800 |

| |

| 基金项目: | 国家自然科学基金资助项目(51975217)。 |

| |

| 摘 要: |

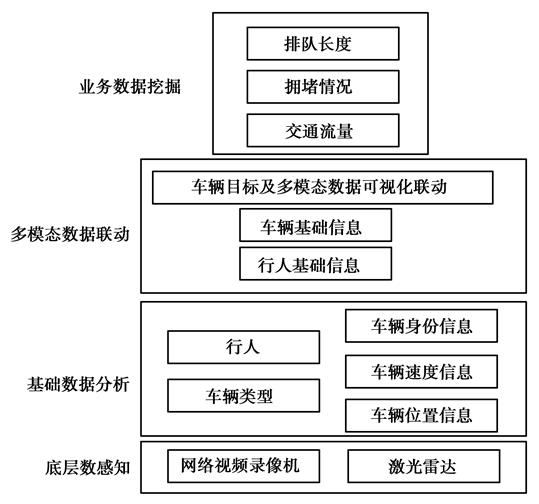

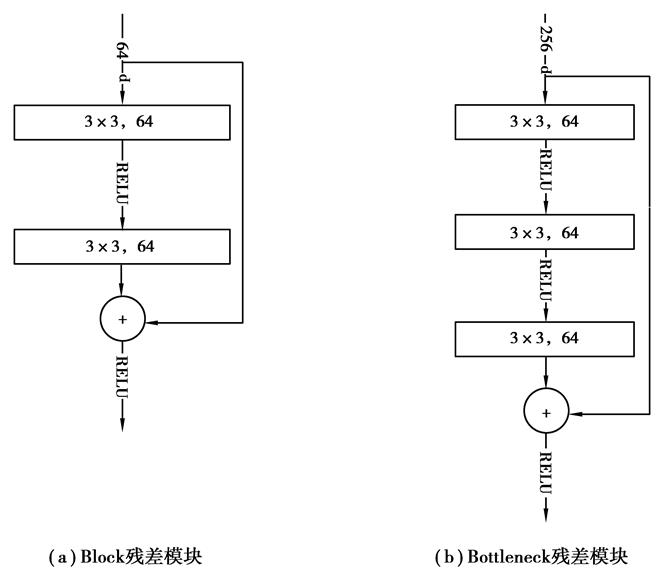

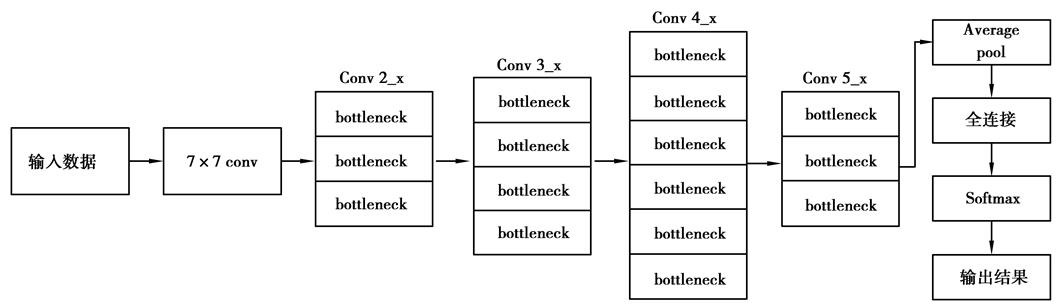

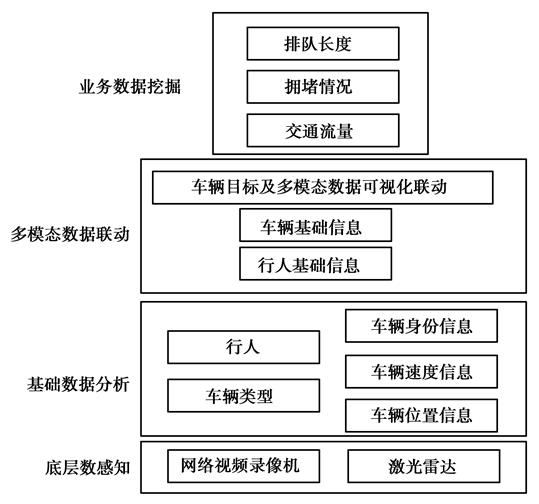

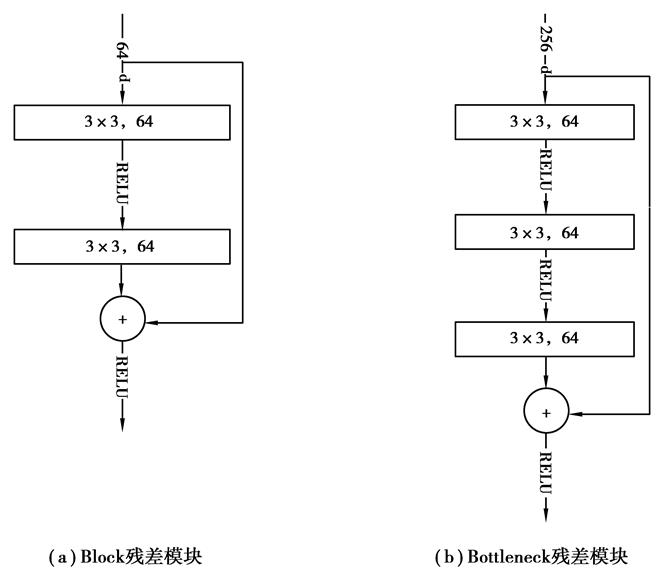

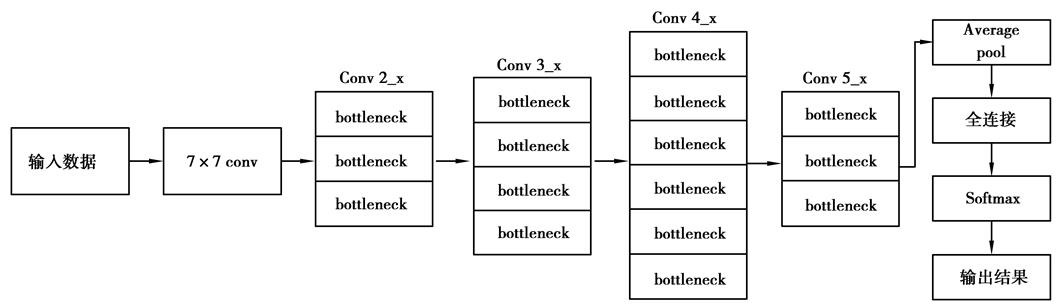

研究提出一种面向自动驾驶的多模态信息融合的目标识别方法,旨在解决自动驾驶环境下车辆和行人检测问题。该方法首先对ResNet50网络进行改进,引入基于空间注意力机制和混合空洞卷积,通过选择核卷积替换部分卷积层,使网络能够根据特征尺寸动态调整感受野的大小;然后,卷积层中使用锯齿状混合空洞卷积,捕获多尺度上下文信息,提高网络特征提取能力。

改用GIoU损失函数替代YOLOv3中的定位损失函数,GIoU损失函数在实际应用中具有较好操作性;最后,提出了基于数据融合的人车目标分类识别算法,有效提高目标检测的准确率。实验结果表明,该方法与OFTNet、VoxelNet和FasterRCNN网络相比,在mAP指标白天提升幅度最高可达0.05,晚上可达0.09,收敛效果好。

|

| 关 键 词: | 自动驾驶 ResNet50 YOLOv3 数据融合 注意力机制 损失函数 |

| 收稿时间: | 2023-05-12 |

|

| 点击此处可从《重庆大学学报(自然科学版)》浏览原始摘要信息 |

|

点击此处可从《重庆大学学报(自然科学版)》下载全文 |

|